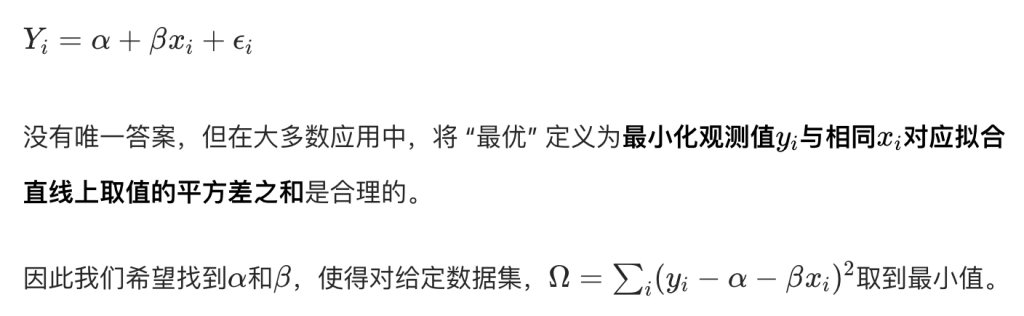

这篇内容主要是在系统介绍简单线性回归:先假设响应变量 \(Y\) 与解释变量 \(x\) 之间满足 \(Y_i = \alpha + \beta x_i + \varepsilon_i\) 的线性关系,并在误差均值为0、同方差,进一步可假设正态分布的前提下,用最小二乘法估计回归直线的截距和斜率;然后研究这些估计量的统计性质,包括它们的无偏性、方差和误差方差的估计;接着说明如何利用拟合直线对新的 \(x\) 值进行预测,并构造平均响应和单个新观测的置信区间/预测区间;最后再通过残差、残差图、QQ图以及决定系数 \(R^2\) 等方法,检查线性、同方差、正态性等假设是否合理,并评价模型对数据的拟合效果

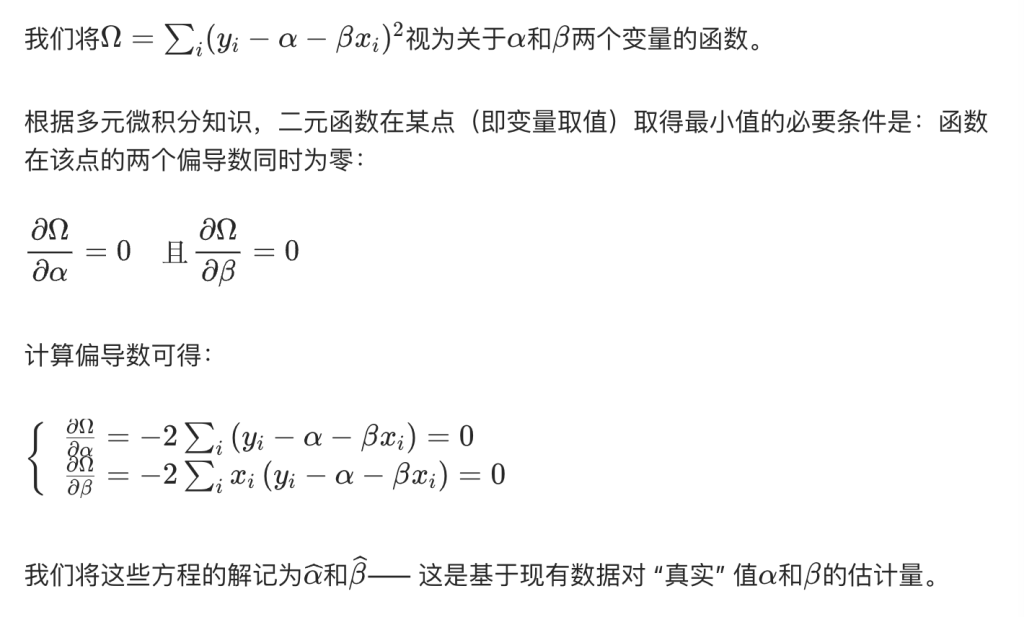

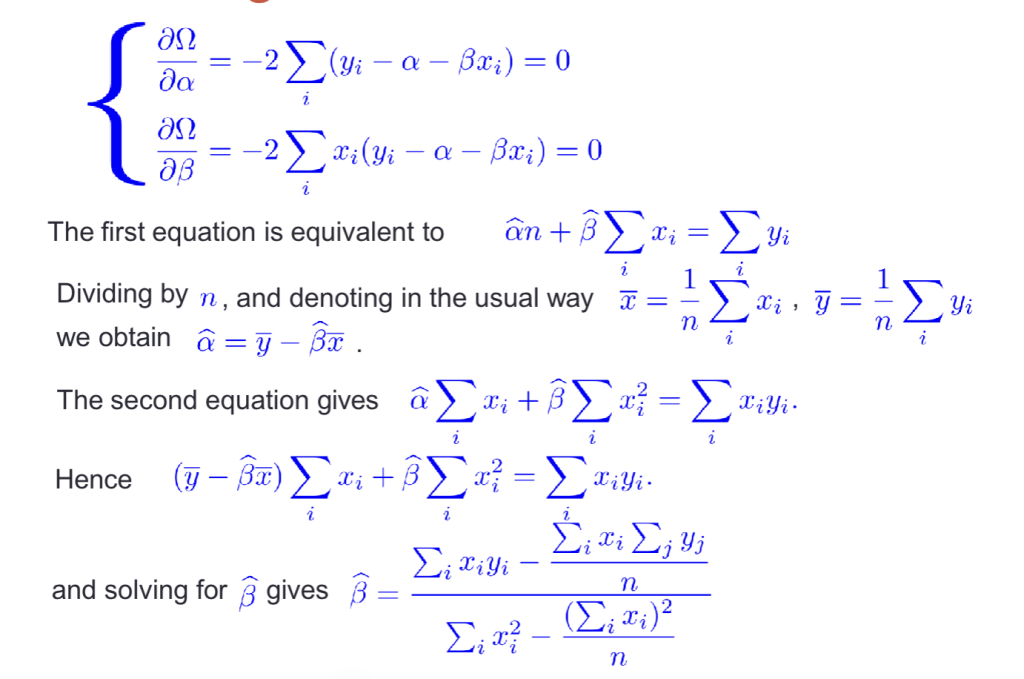

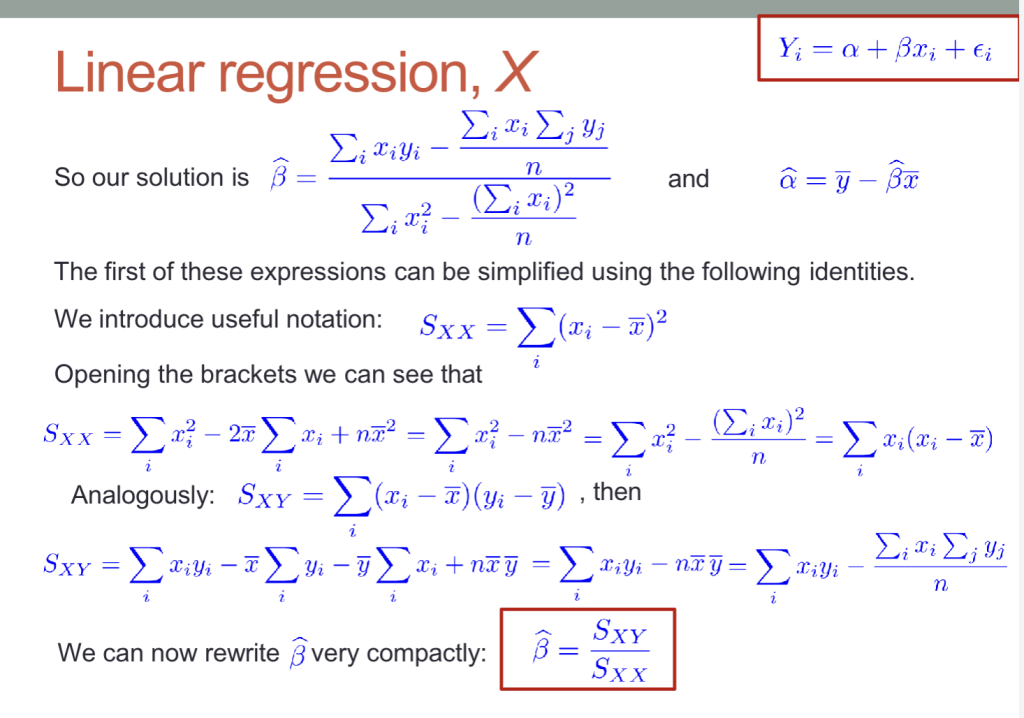

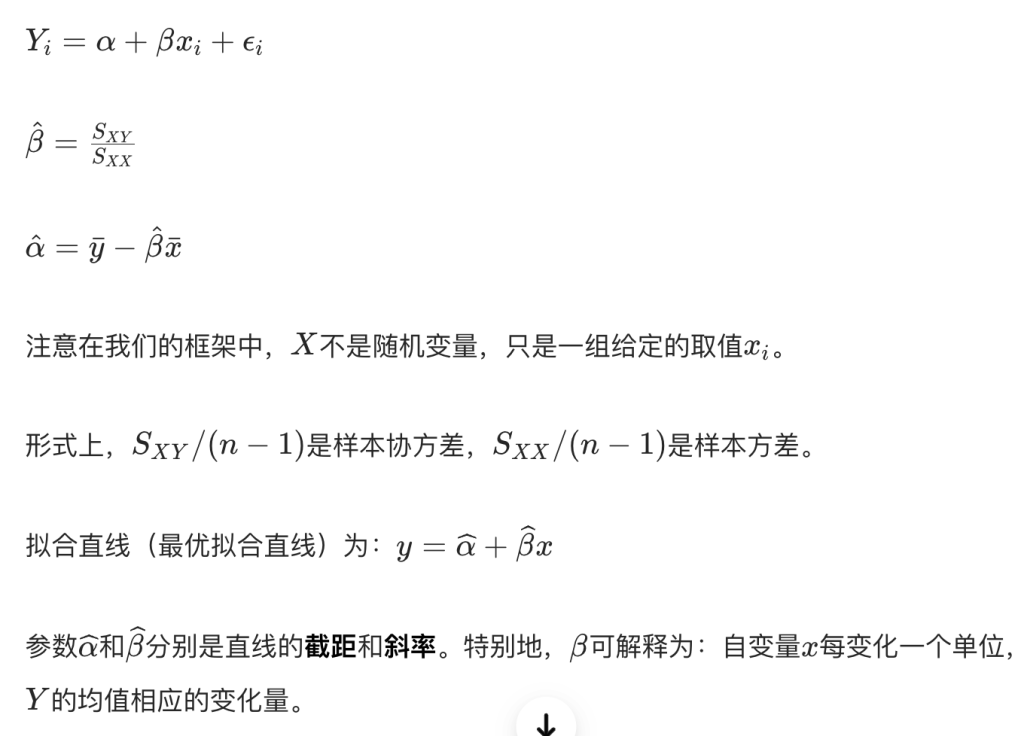

求解alpha和beta

- 引入汇总量符号Sxx和Sxy

- x 这一列数据自身的波动有多大

- 如果所有 x_i 都差不多,那 S_{XX} 就很小。

- x 和 y 的共同变动程度

- 如果 x 大的时候,y 往往也大,那么 S_{XY}>0

- x 这一列数据自身的波动有多大

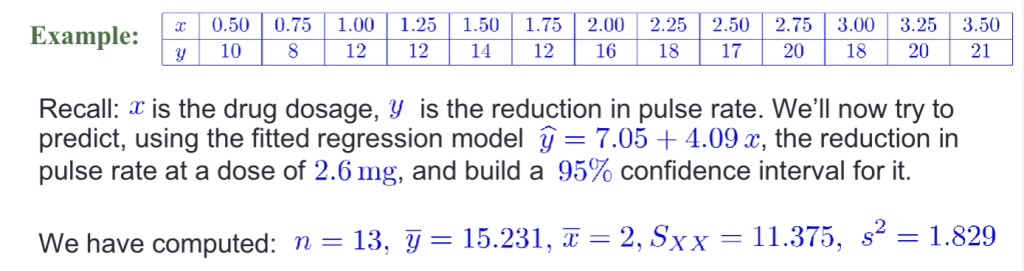

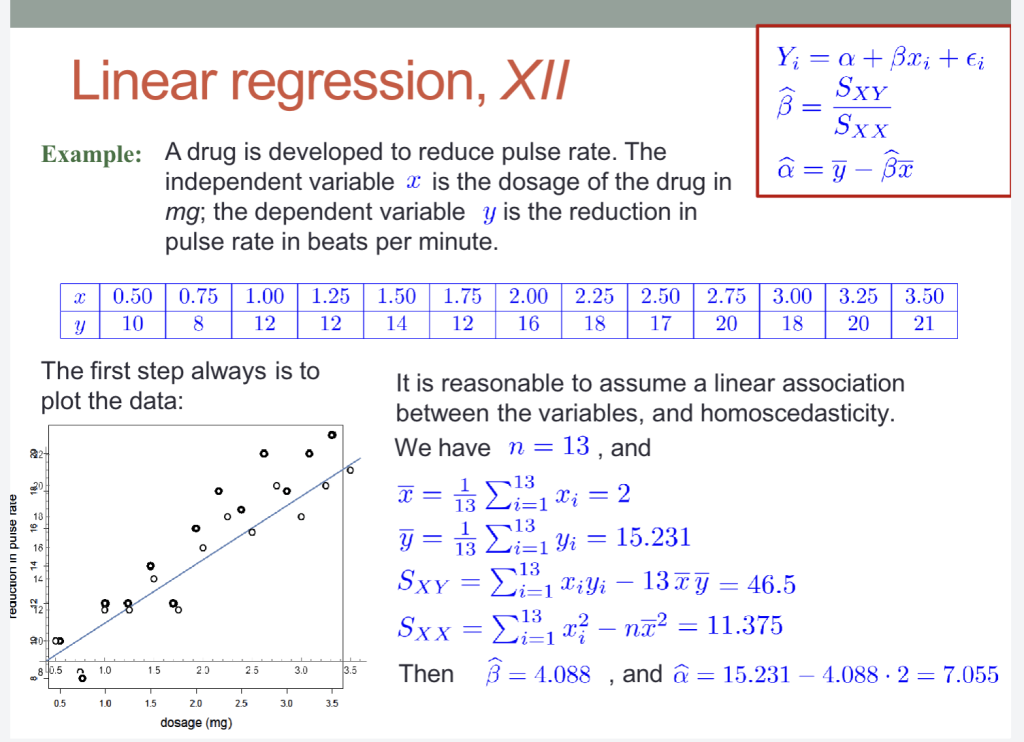

例题:

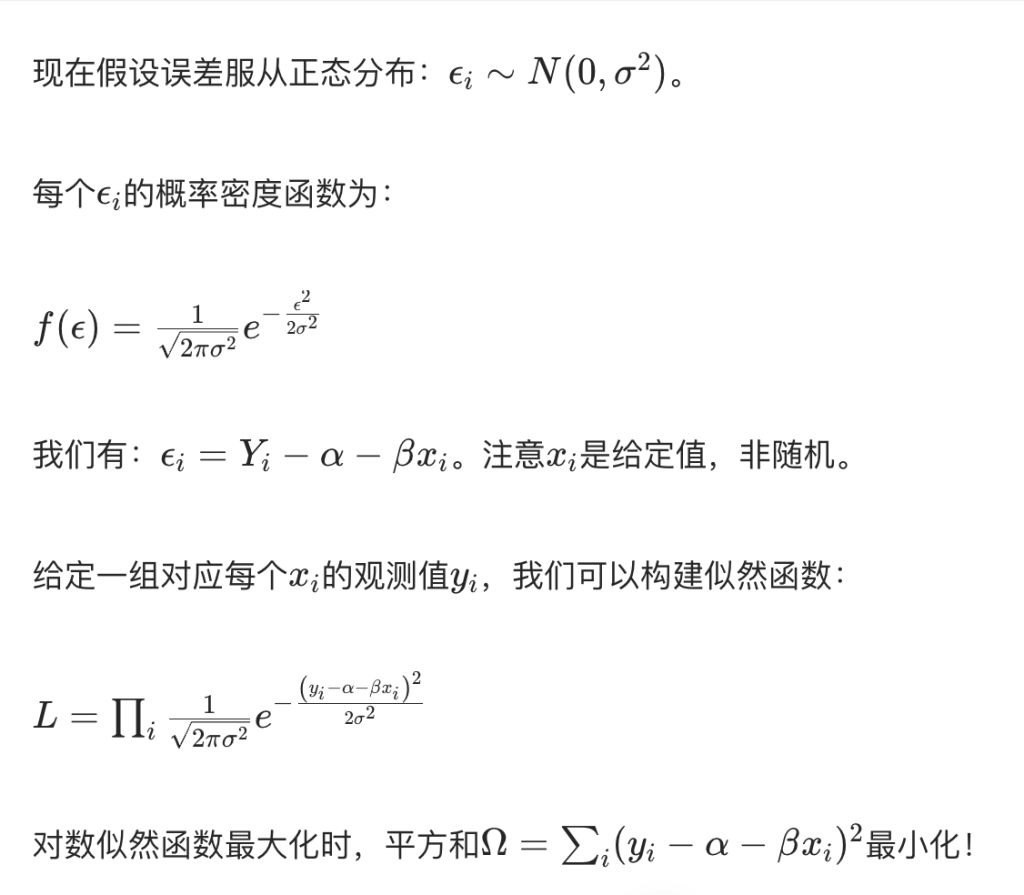

极大似然估计MLE下的最小二乘法

- 在假设误差服从正态分布时,用最小二乘法拟合直线,其实等价于用极大似然估计去找最可能产生这组数据的参数

- 回顾:什么是极大似然估计:在已知结果的情况下,反推什么样的参数,能让当前观测到的数据出现的概率最大?

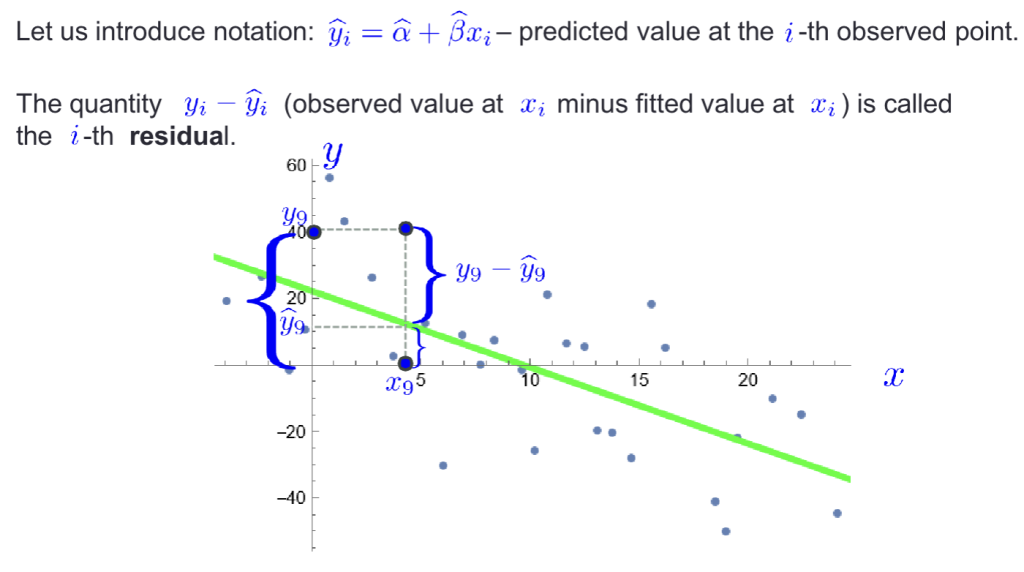

Residuals 残差

估计量的性质

估计量的期望

证明略

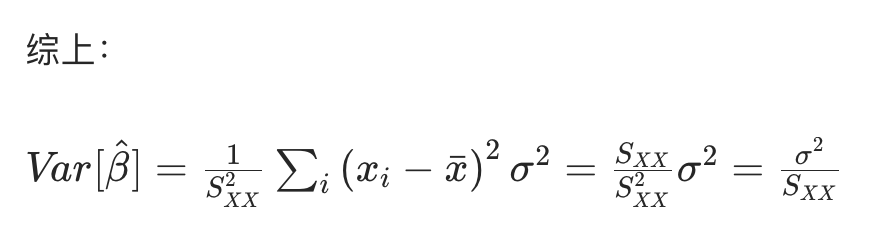

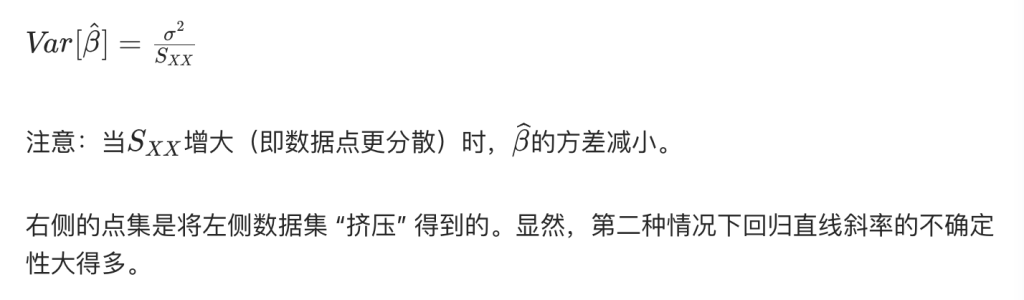

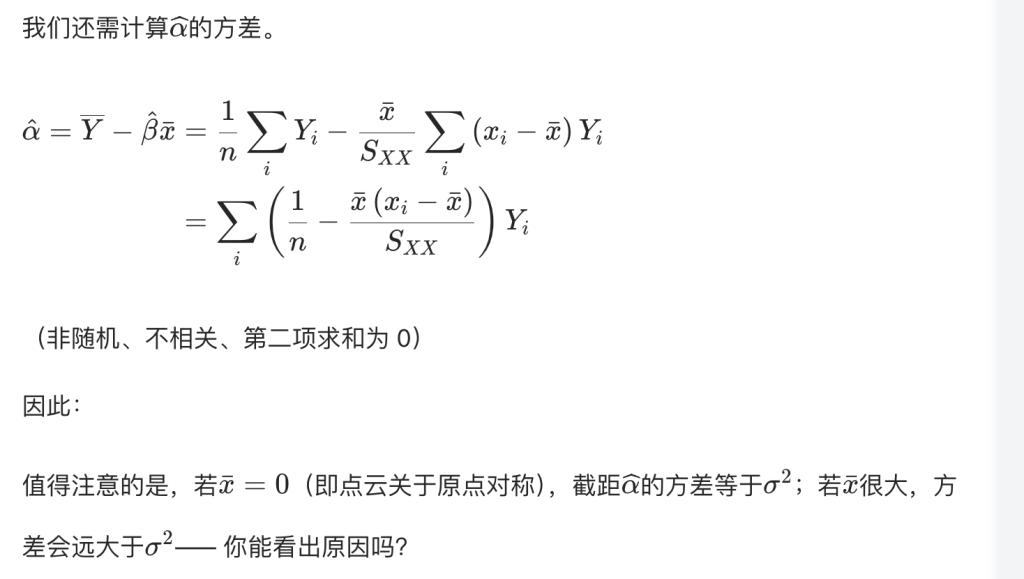

估计量的方差

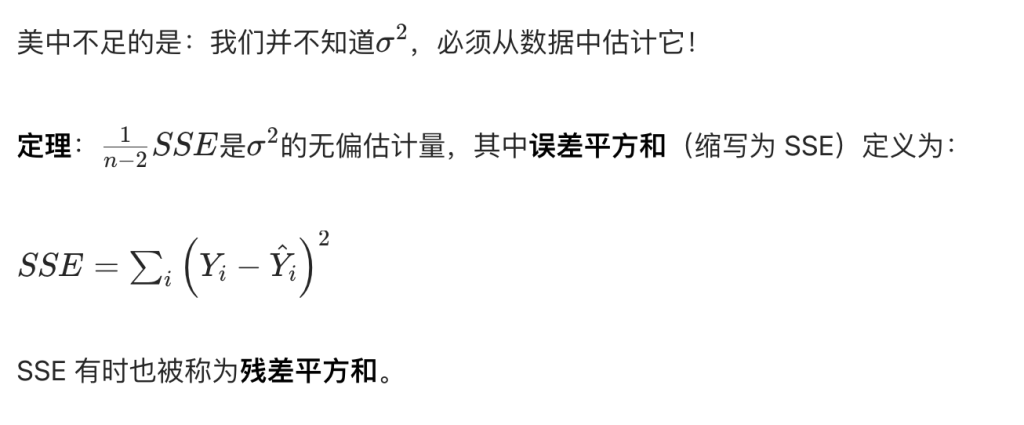

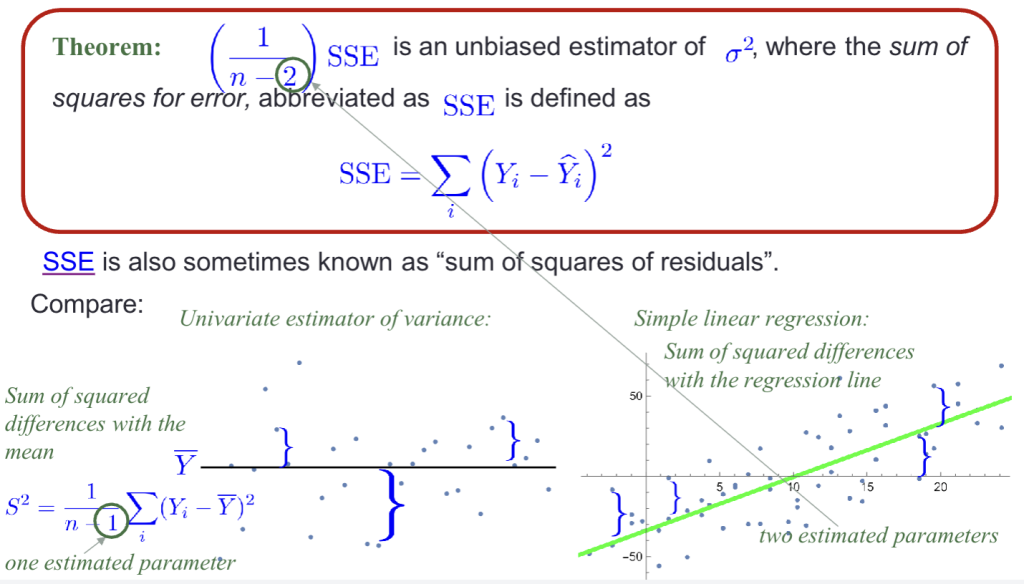

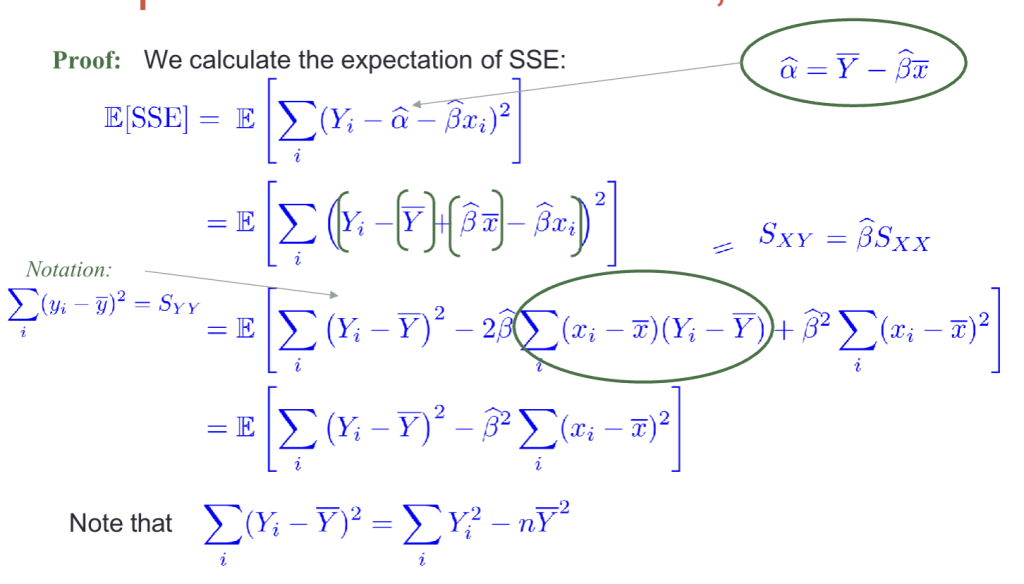

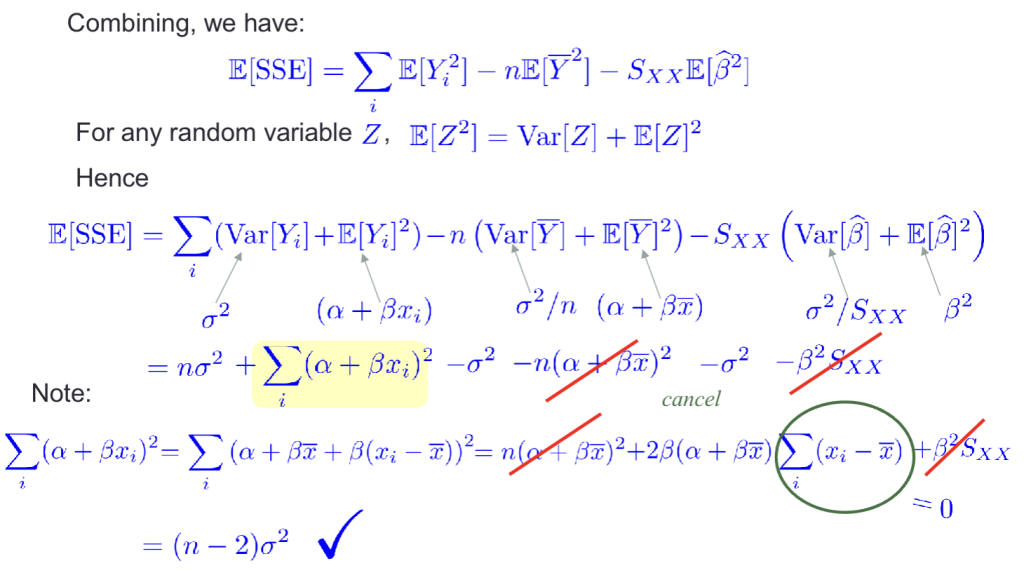

残差平方和 – 用于估计真实的方差

SSE的期望,算这个有什么用处嘛?

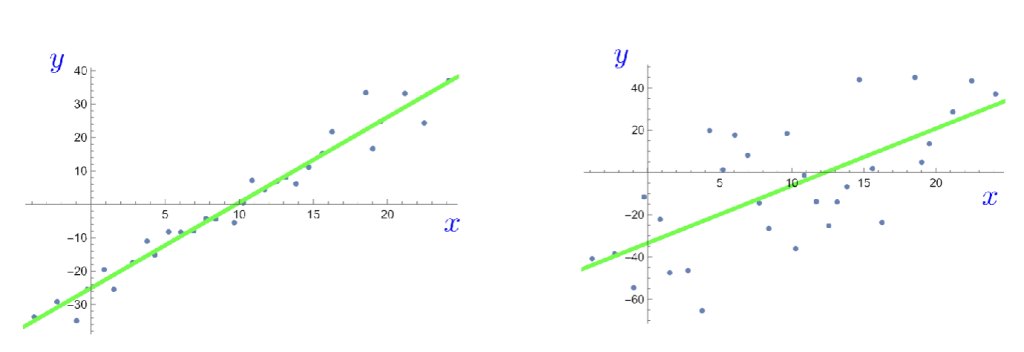

Goodness of Fit 拟合优度

- 拟合直线是否能充分代表数据?

- 换句话说,我们能否找到量化区分以下两个示例的指标?y的离散程度有多少能被线性趋势解释?

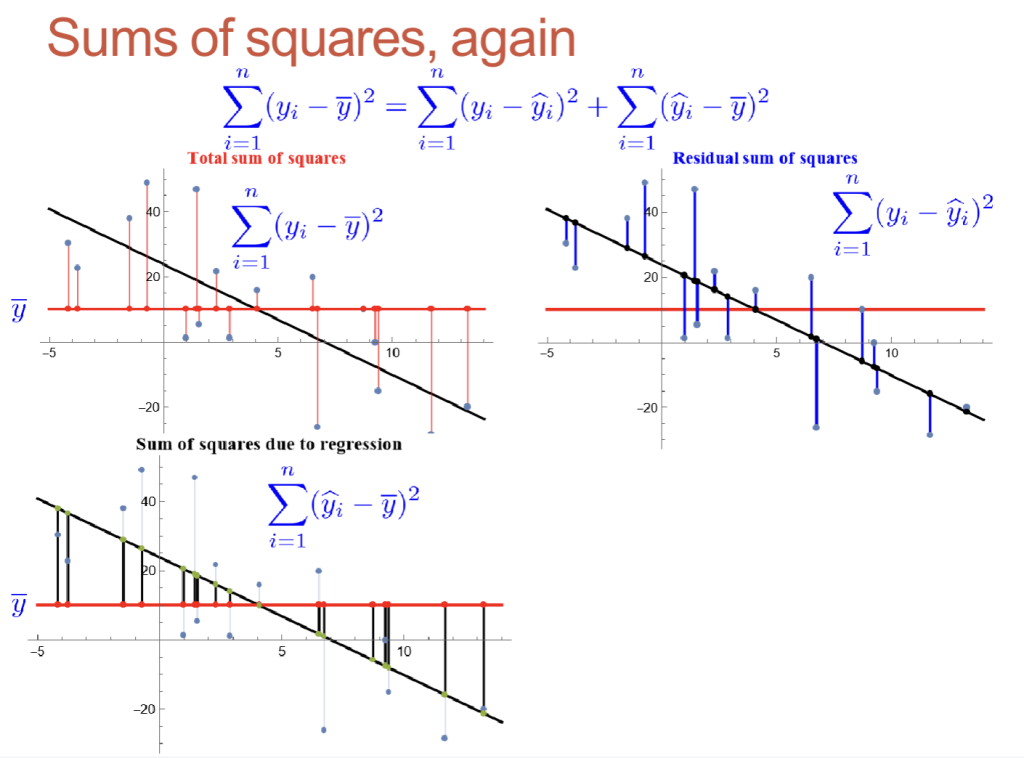

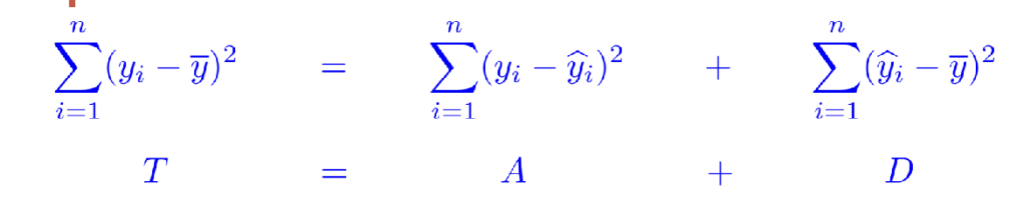

$$ \sum_{i=1}^{n} (y_i – \bar{y})^2 = \sum_{i=1}^{n} (y_i – \hat{y}_i)^2 + \sum_{i=1}^{n} (\hat{y}_i – \bar{y})^2 $$

- 右侧第一项:观测值yi与对应拟合点的偏差平方和。直接衡量直线对原始观测的拟合紧密程度。若该值小,说明直线拟合紧密,可认为仅为 “实验误差”;若该值大,提示线性假设不合适。该量常称为残差平方和,即拟合直线后未被解释的变异剩余部分。

- 右侧第二项:拟合值yi与其均值的偏差平方和(yi的样本均值为yˉ),衡量拟合直线的陡峭程度。常称为回归平方和。

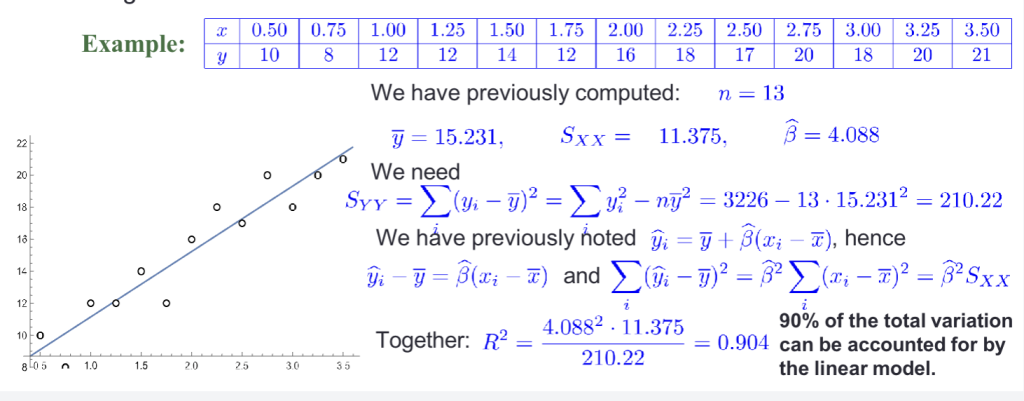

Coefficient of determination 决定系数

Definition: $$ R^2 = \frac{\sum_i (\hat{y}_i – \bar{y})^2}{\sum_i (y_i – \bar{y})^2} $$

该系数取值在 0 到 1 之间,非正式地用作直线拟合优度的度量。

严格来说,R2是响应变量的总变异中,能被线性回归模型解释的比例。

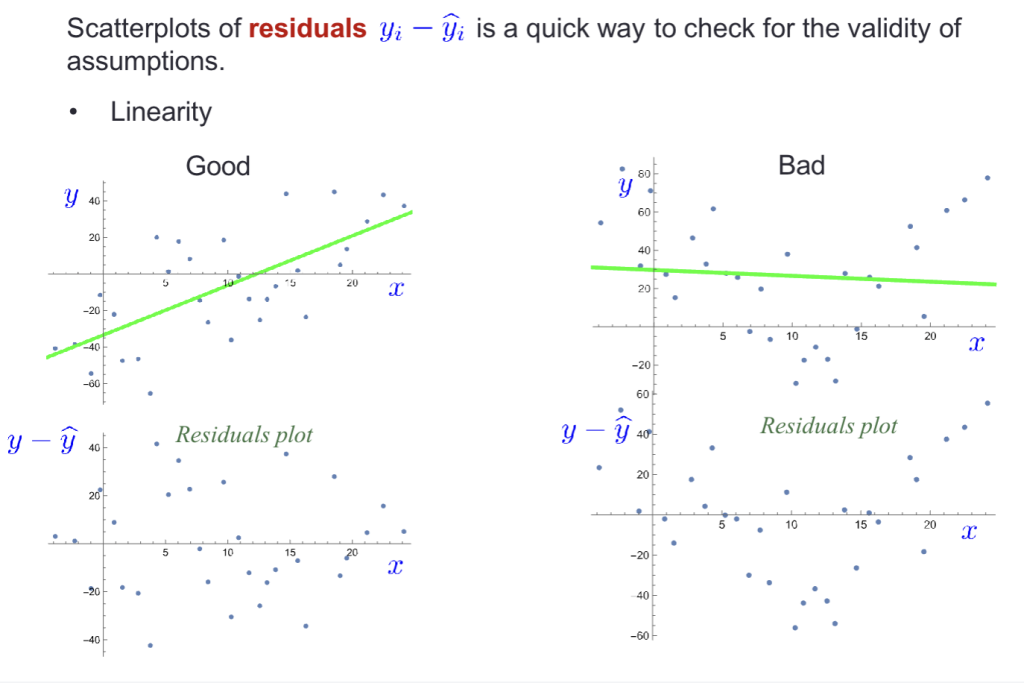

Analysis of residuals 残差分析

- 残差图的点分布没有明显趋势,是随机分布时,说明线性关系基本合理

- 右侧的残差图明显是个U分布

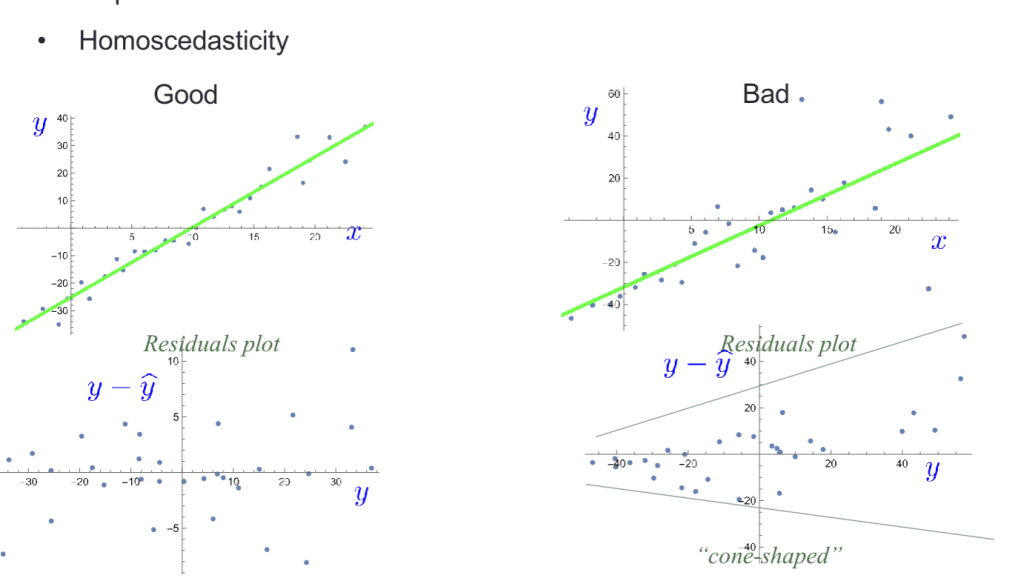

Homoscedasticity同方差性

- 模型在所有 x 区间,预测稳定性都差不

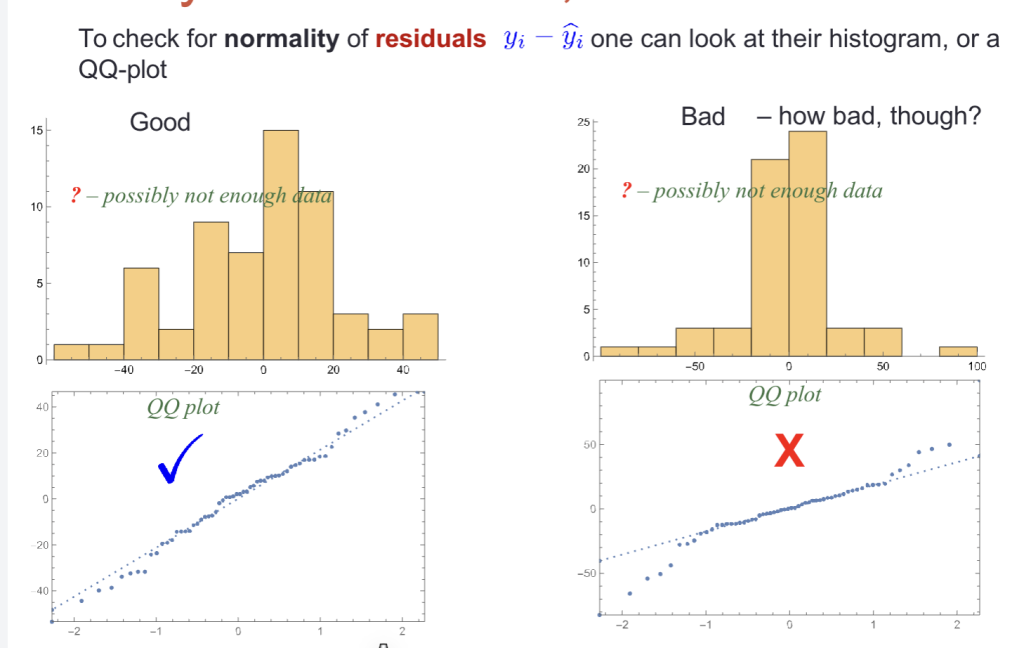

想检查残差是否正态,可以看残差的直方图,或者看 QQ 图

线性性检验

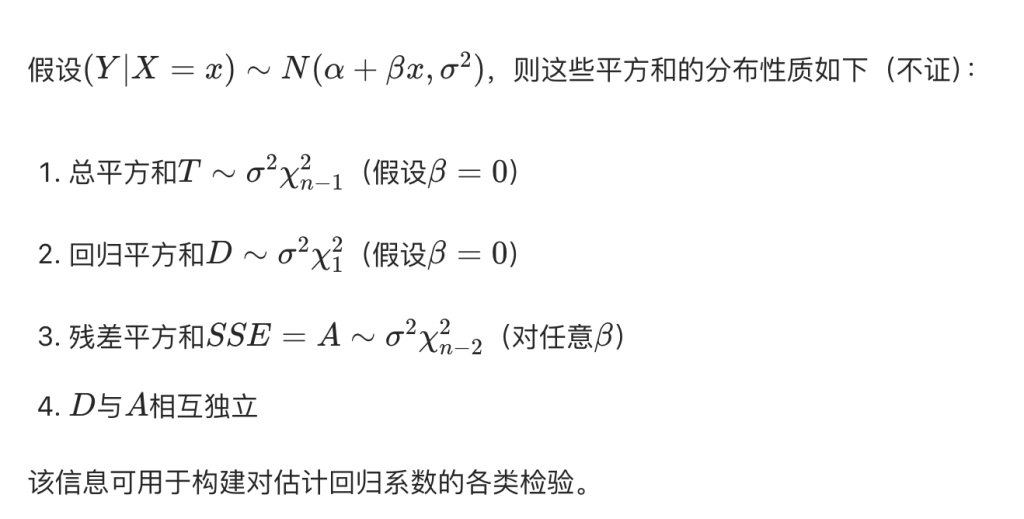

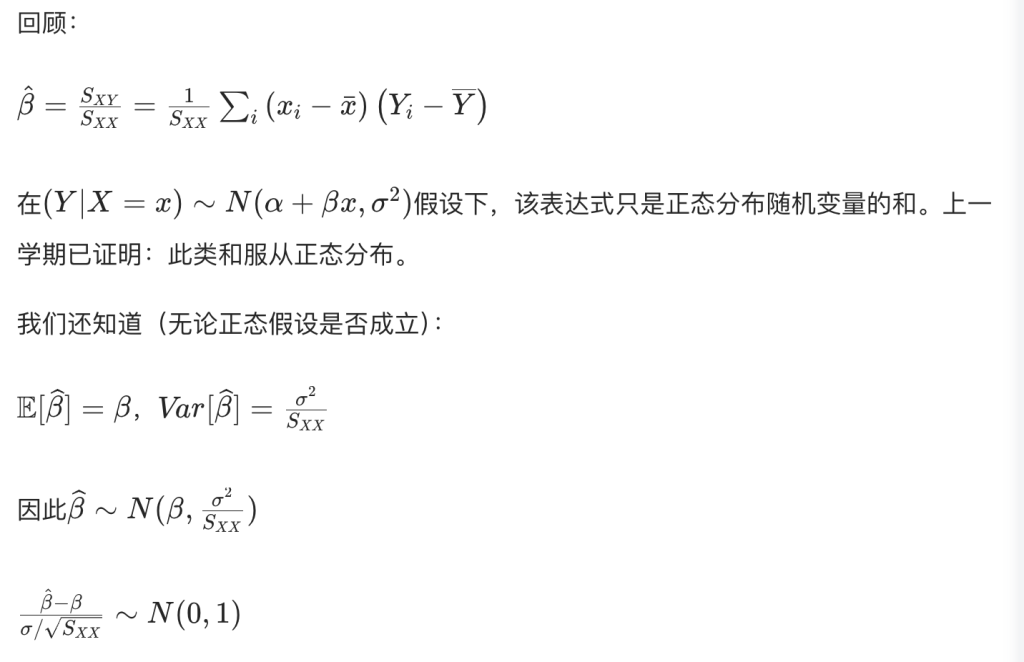

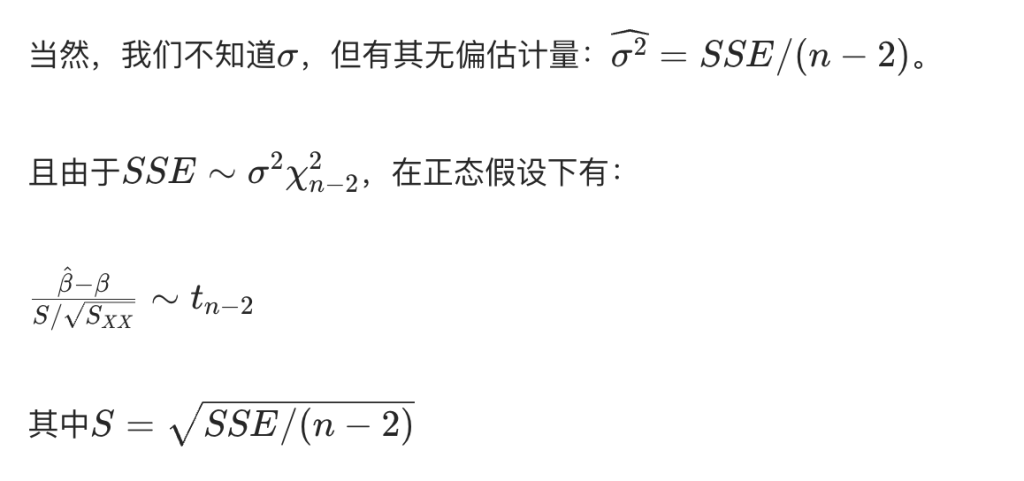

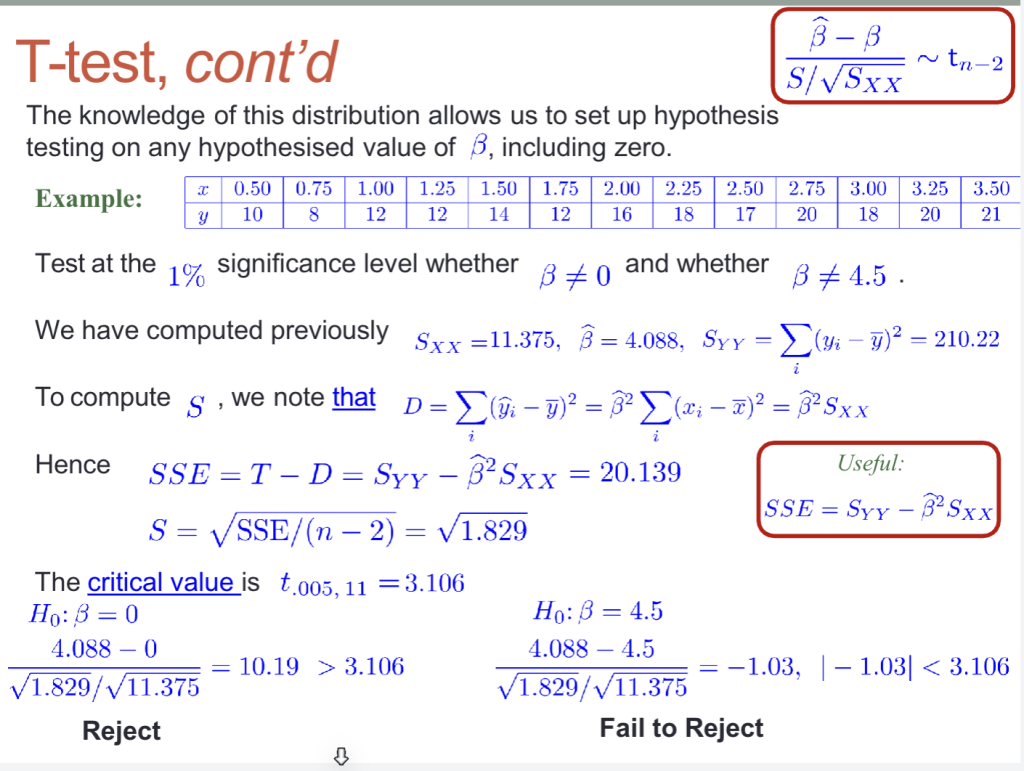

我们通常关心的不是\(\beta\)的具体取值,而是定性判断数据中是否存在线性趋势。 即检验: $$ H_0: \beta = 0 \quad \text{vs} \quad H_1: \beta \neq 0 $$ 注意我们假设数据可被直线良好拟合,问题仅在于直线是“水平”还是“倾斜”。 回顾前述定理:

t-检验

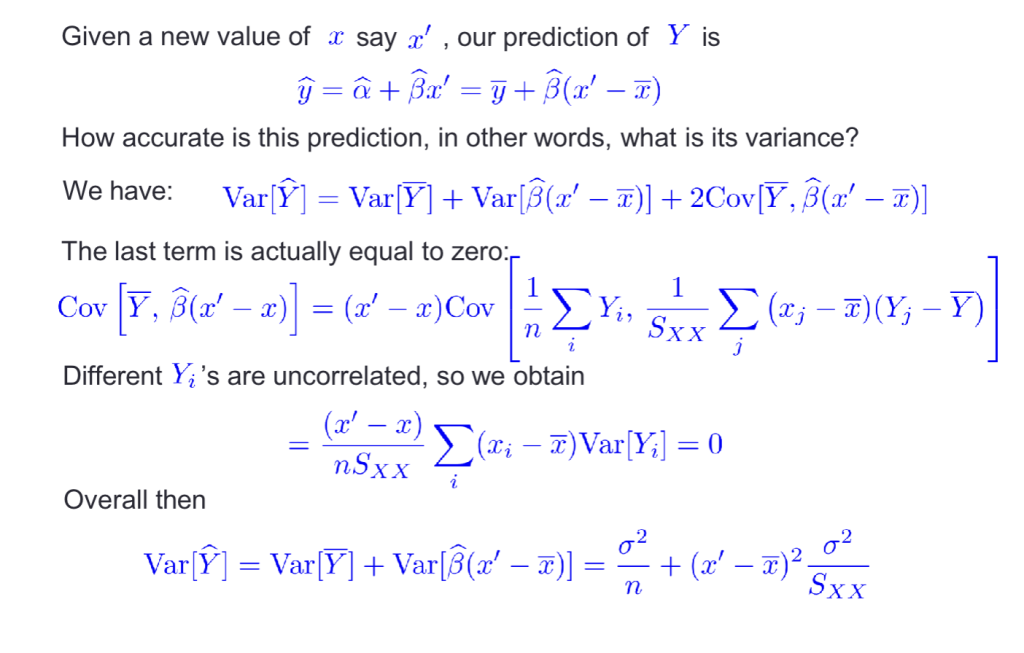

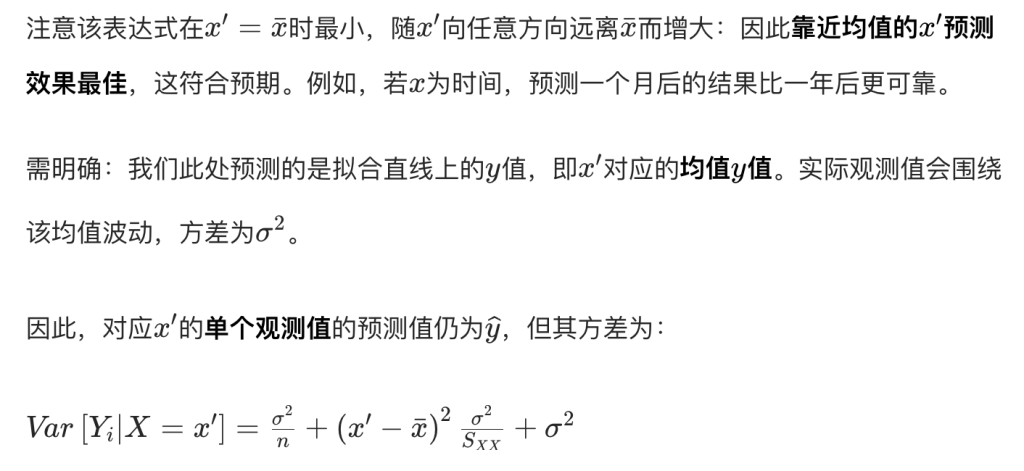

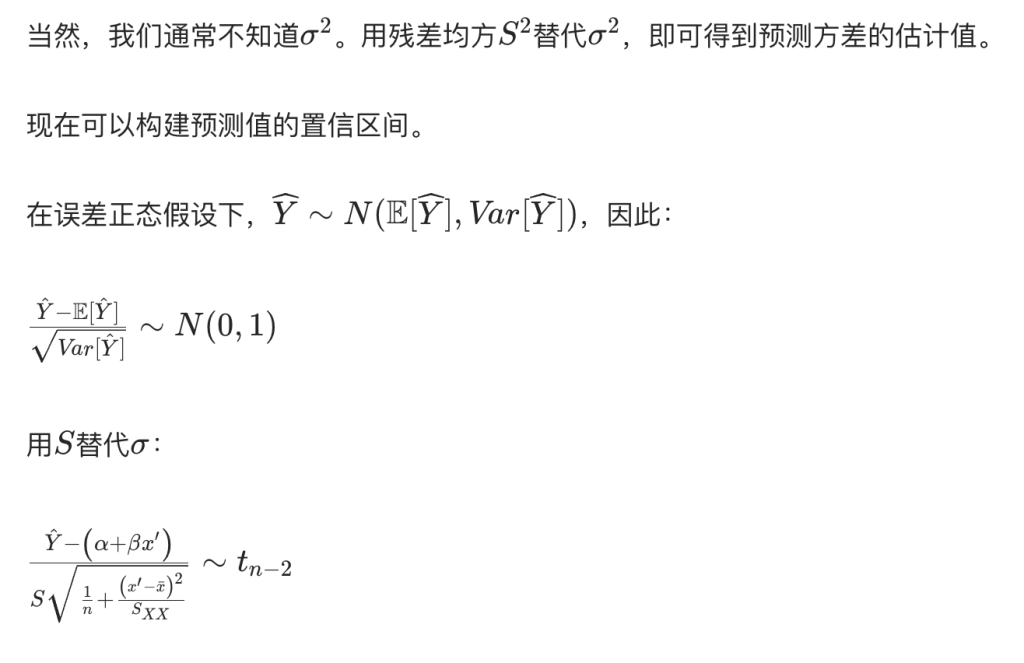

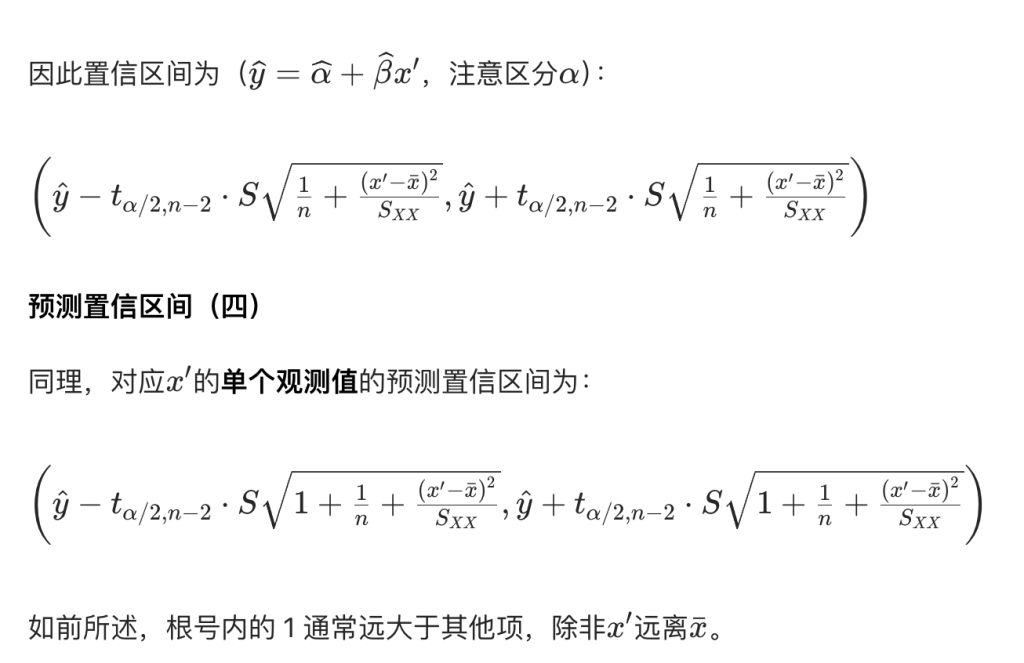

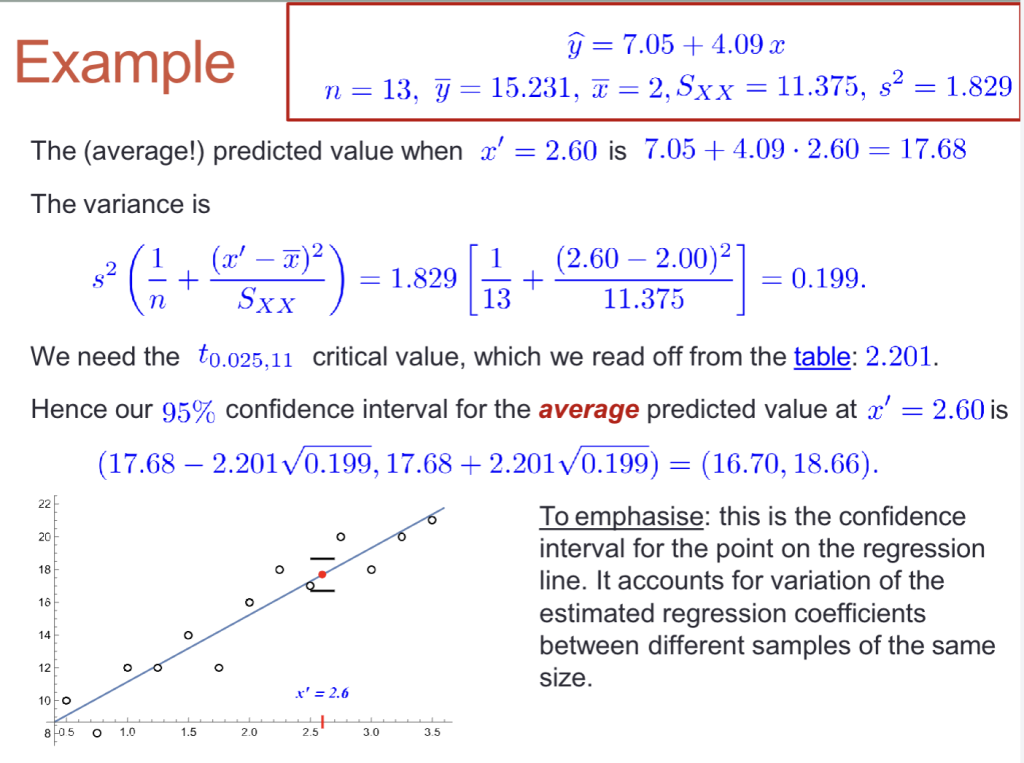

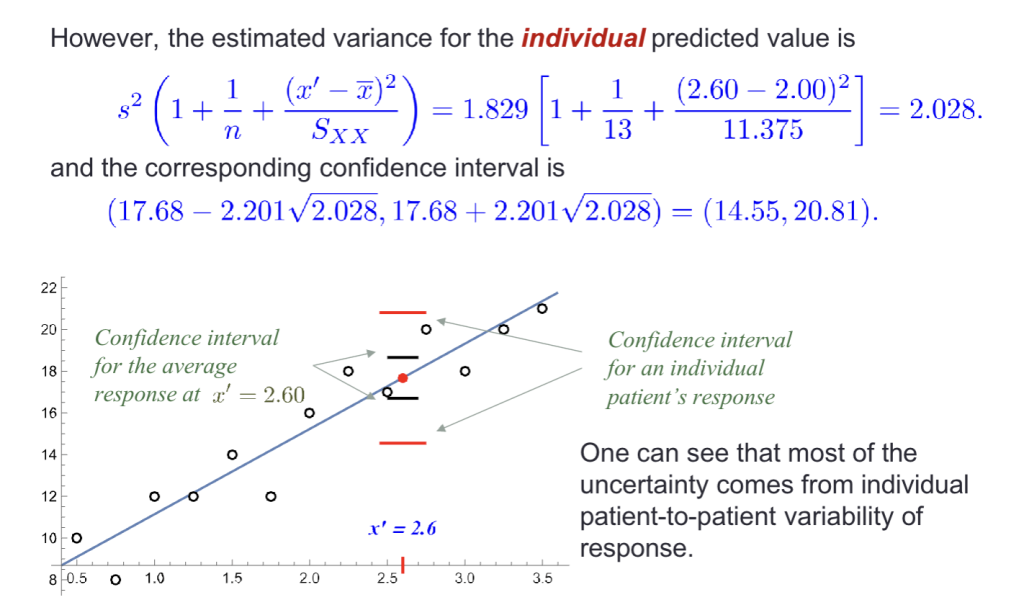

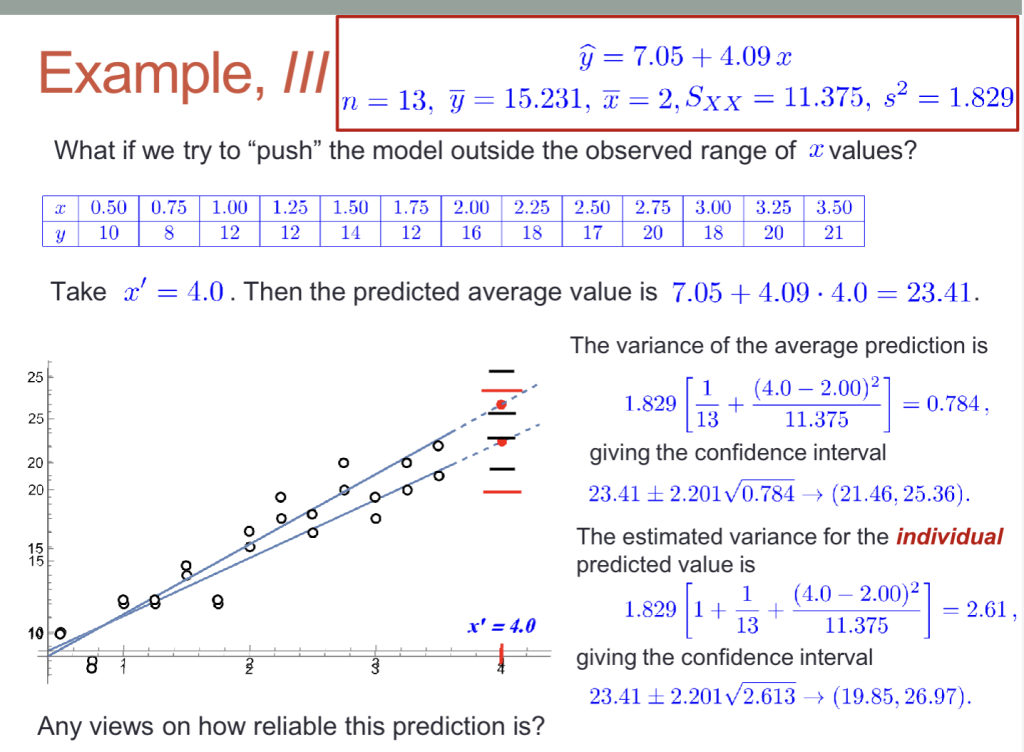

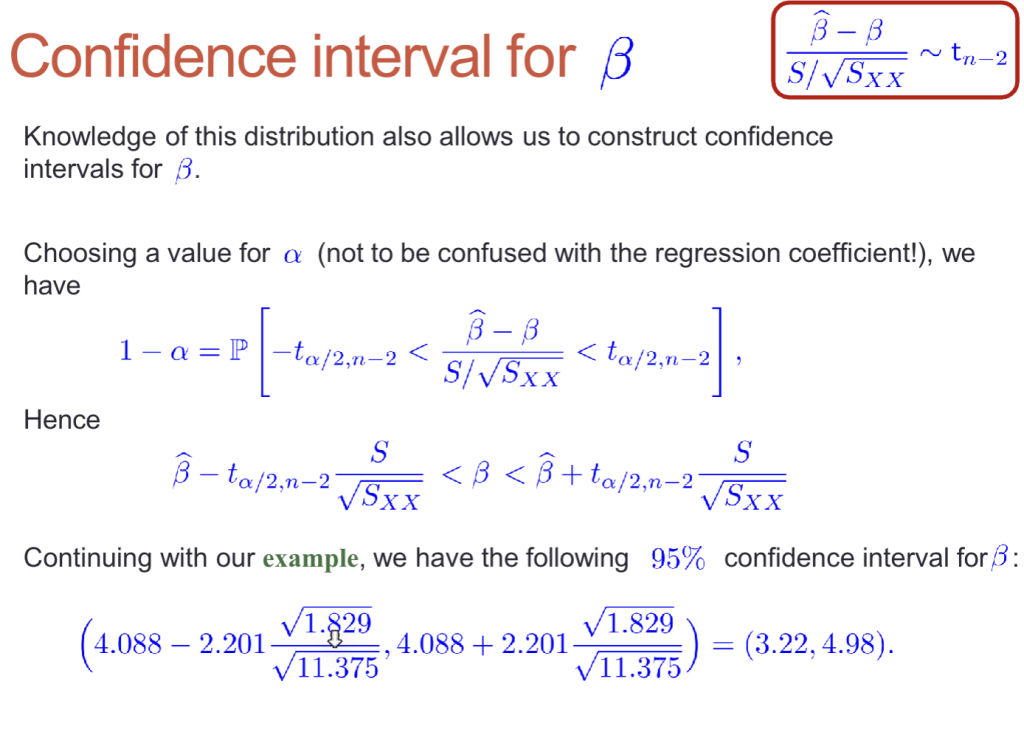

预测Y与置信区间